Du suchst einen echten KI-Videogenerator? Du willst ein KI-Video generieren und dabei faul auf dem Sofa liegen? Oder Freizeitvergnügungen nachgehen, wie der Ballet-tanzende Roboter in meinem mit RunwayML generierten Video? Oder uncreepy Menschen wie in diesem Luma Ray3 Video aus Adobe Firefly? Oder High Quality Szenen mit Google Veo (das dritte Beispiel in 9:16)?

Du hast die Wahl:

- Video-Generatoren für KI-Video-Avatare

- Stock-Footage-Video-Zusammenbasteltools wie InVideo* (nutze ich selbst, denn nur damit bekommt man Production-Ready-Videos raus, die man auch wirklich einsetzen kann). Um aus Stock Footage ein zusammenhängendes Video zu erstellen – mit Texteinblendungen etc. – kannst du auch PowerPoint nehmen. Kein Witz. Funktioniert und ist von Laien editierbar.

- KI-Videogeneratoren für kurze Sequenzen, Google Veo von Google Gemini oder Runway für Einzelszenen (dazu gleich mehr) oder Adobe Firefly (mit Luma Ray3 oder Firefly Video), Kling AI aus China (da genügt ein Prompt), Sora von ChatGPT, und und und und. Wan gibt’s auch, das läuft bei Bedarf lokal auf dem Rechner (die 14B-Variante braucht afaik 24 GB Video-RAM für 720p in ComfyUI, mit 16 GB Video-RAM geht oft nur die 5B-Variante, und die ist superschlecht).

- Urheberrechte? Reden wir nicht drüber – eigentlich ist nur Firefly Video „commercially safe“, aber das ist – wie wir gleich sehen – oft creepy. Bei Runway könnte es bald besser werden, da es einen Trainingsdaten-Deal mit den Lionsgate-Filmstudios gibt.

- Hauptproblem bei allen Videogeneratoren: Meistens ist bei 8-15 Sekunden je Szene Schluss, und aufeinanderfolgende Szenen im exakt gleichen Stil und in 4k sind „schwierig“ (übers Prompting allerdings lösbar).

In diesem Artikel findest du einen kleinen Testbericht zu Runway, Oxolo und HeyGen (KI-Video-Avatare), Google Veo. InVideo AI und Invideo Studio (Aus-Stock-Footage-Video-Erstell-Programm) und Canva & Adobe Express (nur Schnitt und Post Production) plus Adobe Firefly. Speziell InVideo Studio solltest du im Auge behalten. Akool.com erwähne ich nur hier und ganz kurz (bei Video-Avataren mit Voice Clone ist das ziemlich gut!). Weiter unten gibt es ein paar InVideo-Beispielvideos.

tl; dr: Ich bin Fan von „Pay per Use“ (= API) statt Abo-Modellen mit endlichen Credits. Deswegen ist mein „Testsieger“ aktuell Google Veo 3.1. (obwohl Kling, Seedance, Runway etc. oft bessere Ergebnisse liefern).

- Die ersten Tests machst du bitte mit Google Flow (nach 10 Generierungen ist Schluss, nicht wundern. Die Videos haben ein Wassserzeichen)

- Und danach „Pay per Use“ über das Google AI Studio (ohne Wasserzeichen) (Zahlungsmethode hier hinzufügen: https://console.cloud.google.com/billing/) (Ich habe 250 Euro gratis Startguthaben bekommen, und wenn ich die bekomme, bekommt die jeder, ich bin kein Influencer). Alternativ gibt es Veo 3.1 auch in Google Vertex, also auch API, (da zahlt man die „Computermiete“, bspw. 10 bis 60 ct. pro Sekunde). Da sind die Generierungsergebnisse allerdings deutlich (!) schlechter als im Google AI Studio. Das verstehe wer will. Dafür gibt es kein Rate Limit, du kannst also (relativ) unbegrenzt viele Videos generieren.

- Google Veo versteht auch Prompts, die man in JSON schreibt. Damit ist es einfacher, den Look konsistent zu halten und die 8 Sekunden in Unterszenen zu unterteilen bzw. Kamerafahrten zu definieren. Funktioniert natürlich nicht immer so wie man’s will. Unten ist ein Beispiel.

- Lokal: Wenn du einen aktuellen Mac oder PC mit 64 GB RAM hast (Annahme: mind. 32 GB des RAMs kann das System als „Grafikkarte“ sehen) (oder du hast eine Nvidia-Karte mit mind 24 GB RAM), dann lohnen sich Experimente mit ComfyUI und WAN (Und ohne eigene Hardware kann man sich Rechenzeit in der Cloud mieten, u.a. mit Runpod.io).

Über den Autor

Stefan Golling, Köln. Seit 2011 unterstütze ich freiberuflich Unternehmen bzw. Agenturen mit kreativen Ideen, Konzepten und (textlichen) Umsetzungen rund ums (Online-)Marketing. Vorher: 1998 mit Radiowerbung in Stuttgart gestartet, 2000 als Junior-Werbetexter zu Publicis München, 2001 Counterpart Köln, 2002 als Copywriter zu Red Cell Düsseldorf (heißt heute Scholz & Friends), dort ab 2007 Creative Director.

Inhalt

Was ist ein KI-Videogenerator?

Ein KI-Videogenerator erschafft auf der Grundlage einer Texteingabe (oder eines Bildes, oder eines Videos) ein Video – in der Theorie. In der Praxis sieht es schwieriger aus:

- Deine Erwartung: Du gibst einen Prompt ein, und das KI-Tool produziert ein Bewegtbild-Video, also beispielsweise 24 aufeinanderfolgende Bilder je Sekunde, und zwar in Hollywood-Qualität.

- Die Realität: Das klappt aktuell nicht – wenn man als Maßstab einen professionellen Werbespot hat. Denn der hat a) viele Szenen, b) einen konsistenten Look, c) Effekte, d) Einblendungen, e) Packshots und f) natürlich echte Schauspieler oder Characters.

Einige Elemente gehen jedoch mit KI. - Was wird dir als KI-Videogenerator verkauft? Drei Varianten:

- KI-Text-to-Video-Generatoren: Funktionieren noch nicht so richtig gut, aber sind für den Ideation-Prozesse natürlich super. Damit kannst du deine filmischen Ideen, die du im Kopf hast, schnell visualisieren. Das ist genial für Werber, Drehbuchautoren, Regisseure, DOPs (Kameraleute), für die Marktforschung und vieles mehr. So könntest du dir ein Kinofilm-Drehbuch per KI als Video generieren lassen, um vor dem Dreh einen Eindruck einer Endfassung des Films zu erhalten. Prinzipiell kannst du dann den Schnitt schon vorher machen und sparst dir den Dreh von Sachen, die im Schnitt rausgeflogen wären.

„Production Ready“-Qualität funktioniert noch am Ehesten bei Cartoons, oder für einzelne Szenen im Film.

Unterschätze nicht die Kosten: Bei Google Veo kostet, über die API (AI Playground), die Erstellung von 2 Minuten Video (= 14 Takes à 8 Sekunden in 720p) ungefähr 30 Euro. Rechne also grob mit 2 Euro je Versuch. Auch jeder Fehlversuch kostet. Rechne also lieber mit 100 Euro aufwärts, und trotzdem wird nicht alles so sein, wie du es haben wolltest. - KI-Avatar-Video-Generatoren. Das ist relativ banal, da meist nur Lippen-, Augen- und Kopfbewegungen animiert werden, von Menschen oder 3D-Figürchen. Hinzu kommen Script-Generatoren (auf ChatGPT-Basis) und Voice-Over-Generatoren (Sprachsynthese, oft mit „Voice Clone“ Deep Fake Technik, um die eigene Stimme zu klonen. Spooky!).

Ein gängiger Verwendungszweck sind Schulungsvideos: Die Produktion von Videos in vielen Sprachen wird ein Klacks. Die Zielgruppe solcher Videos sind Mitarbeiter (die können sich nicht wehren oder beschweren) oder verzweifelte Kunden, die mit deinem Produkt nicht zurechtkommen (die können sich auch nicht wehren).

Es gibt dabei viele Einschränkungen: Bei einem echt gedrehten Video siehst du echte Menschen, die echte Produkte vorführen. Der KI-„Schauspieler“ kann nur einen Text runterlabern. Damit sind die Videos eigentlich bebilderte Podcasts. - KI-Stockvideo-Aussuch-Tools: Das ist sowas wie PowerPoint 2.0, also sagen wir mal „animierte Slides Deluxe“. Mit InVideo AI und (eingeschränkt) InVideo Studio kannst du dir per Prompt ein Script schreiben lassen (oder, besser, du nimmst ein professionelles, durchdachtes Script), und das Tool sucht aus Stock-Libraries passende Video-Teile (und leider auch Fotos) raus und schneidet diese hintereinander. Das ist ziemlich cool, da es das langwierige Raussuchen von Stock Footage massiv beschleunigt.

Über Templates lassen sich sogar Super / Inserts / Bauchbinden automatisch erzeugen.

Doch jetzt kommt auch schon der Schlag in den Nacken: Du hast am Ende nur ein Video aus Stock Footage – uncool, wenn du kein Talent für Bildgestaltung und Filmaufbau hast. Außerdem ist die KI nicht besonders kreativ beim Aussuchen der Szenen (= katastrophal schlecht). Das bedeutet, dass das visuelle Storytelling tradiert, langweilig, vorhersehbar und einfach echt oll ist. Damit lockst du niemanden hinter dem Ofen hervor. Außer: Du investierst massiv in Nacharbeit.

- KI-Text-to-Video-Generatoren: Funktionieren noch nicht so richtig gut, aber sind für den Ideation-Prozesse natürlich super. Damit kannst du deine filmischen Ideen, die du im Kopf hast, schnell visualisieren. Das ist genial für Werber, Drehbuchautoren, Regisseure, DOPs (Kameraleute), für die Marktforschung und vieles mehr. So könntest du dir ein Kinofilm-Drehbuch per KI als Video generieren lassen, um vor dem Dreh einen Eindruck einer Endfassung des Films zu erhalten. Prinzipiell kannst du dann den Schnitt schon vorher machen und sparst dir den Dreh von Sachen, die im Schnitt rausgeflogen wären.

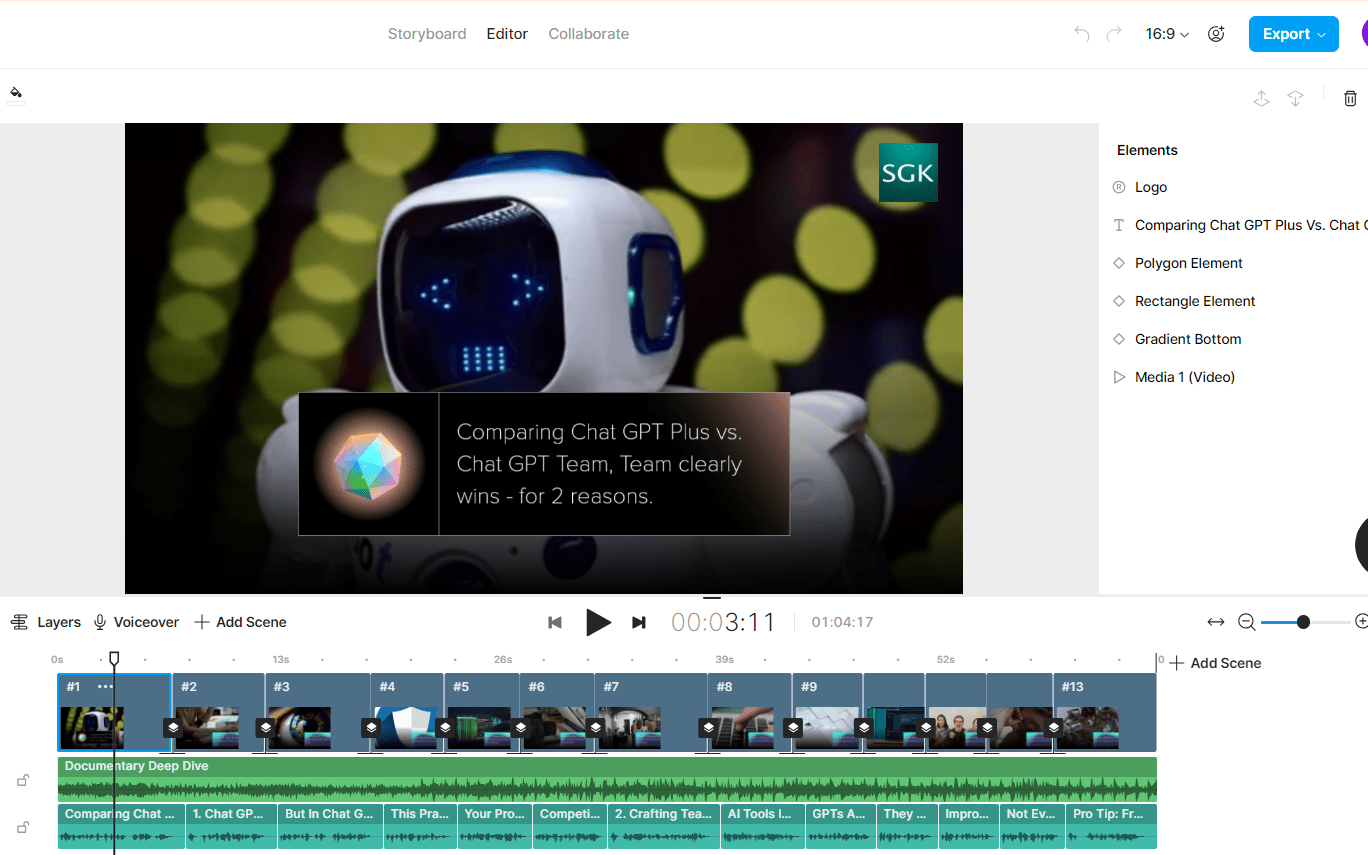

Hier siehst du ein Beispiel, was mit InVideo möglich ist, wenn man ein paar Stunden eigene Gedanken investiert – kein einziges Videoschnipsel wurde von der „KI“ ausgesucht (und Aufbau und Texte kommen auch nicht von der KI). Fun Fact: Der Runway-Roboter von oben ist mit drin, den habe ich eingebaut.

KI-Videogenerierung: 5 Tools stelle ich dir vor

1. Runway

Das Roboter-Video oben ist die Variante „Text to Video“ bei Runway, das klappt ziemlich gut. Aber es geht auch einfacher, wenn du schon Ausgangsmaterial hast – nämlich Image bzw. Video to Video. Vorteil: Dein (Marken-)Look bleibt erhalten, und du kannst auch deine Produktfotos nehmen. (Video to Video geht sogar mit gefilmten Menschen, um den Look zu transformieren).

Runway hat manchmal die Nase ein wenig vorn. Aktuell geht ein Upscaling auf 4k, was woanders nicht geht. Allerdings ist Upscaling nur Upscaling…

Wichtiger sind Funktionen wie mehr Auswahl beim Aspect Ratio – neben 16:9 und 9:16 gehen auch 21:9 oder 3:4.

Über einen „Fixed Seed“ werden Ergebnisse bzw. Looks ein wenig besser reproduzierbar.

So langsam klappt auch „Inpainting / Outpainting“, also das Editing – nicht im Sinne von Schnitt, sondern im Sinne von Post Production bzw. VFX.

Ein kleiner Test mit dem KI-Videogenerator Runway: Ich habe das Tool mit einem von mir KI-generierten Foto (mit Bria erstellt) „gefüttert“, um es animieren zu lassen. Vorgebrieft ist, dass das Foto das „Endframe“ ist. Klappt! Das Video sieht echt gut aus, da Runway hier ein Kino-Style Grading drüberlegt.

Noch besser funktioniert es hier, wenn das Bild das „Startframe“ sein soll: Das Segelschiff überholt das Frachtschiff, das sieht ziemlich gut aus.

Sehr funky ist bei Runway die KI-Video-to-Video-Generierung: Damit änderst du den Style deines Videos. Sogar Presets sind eingebaut, und damit kannst du Schabernack anstellen. Ein Beispiel ist die „Style Reference“ namens „Space“. Das ist jetzt nur ein Auf-die-Schnelle-Versuch ohne eigenen Prompt, aber das Ergebnis ist schon nicht ganz blöd (bis auf die Qualität). Die Idee – ein Schiff überholt das andere Schiff – wurde in die Space-Welt übertragen. Statt Meer gibt es einen Wüstenplaneten, und die Schiffe sehen nach Raumschiffen aus.

Als Inspiration taugt das: Ich sehe in diesem 4-Sekunden-Clip ein „Waterworld“-Remake als Space-Saga, also Madmax mit Space-Wüstenschiffen. Trash? Möglicherweise!

Runway kann noch mehr:

Der Filmprofi denkt bei Videos nicht nur an das Gefilmte, sondern vor allen an die Weiterverarbeitung: Video-Nachbearbeitung, Special Effects / VFX, Color Grading (also die Herstellung eines filmischen Looks), die Retusche, Untertitel etc.

Runway ist hier ziemlich aussichtsreich unterwegs, das könnte sich zum Schweizer Taschenmesser entwickeln.

Nachteile, wie überall: Die Ergebnisse sind nicht immer „Production Ready“, und für kommerzielle Nutzung sollte man auf die Herkunft der Traningsdaten achten – dieses Problem ist dank der Kooperation mit Lionsgate vielleicht bald gelöst.

Was kostet Runway? Das billigste Monatsabo fängt bei 15 Dollar an, und da sind dann ein paar Credits inklusive. Dafür bekommst du in etwa 60 Sekunden KI-Film plus ein wenig Rumgespiele mit den anderen Tools.

Beim KI-Editing werden die Schnittprogramm-Anbieter natürlich nicht schlafen, sondern nachziehen. DaVinci Resolve von BlackMagic hat KI mit drin, unter anderem werden Stimmen erkannt, Texte transkribiert und das Footage automatisch geschnitten. Außerdem kannst du Leute per KI freistellen (Magic Mask) oder per Outpainting Objekte entfernen.

2. Google Veo

Video-Generierung mit Google Gemini klappt ganz gut, hier im folgenden Beispiel auf der Basis eines vorher mit Google Nano Banana generierten Fotos. „Production ready“ ist das Ergebnis nicht: 720p sind zu wenig. Genutzt wurde Veo 2, also nicht das bessere Veo 3. Veo 3.1 ist schon wieder besser, dazu ein Beispiel unten.

Für Vollzugriff auf Veo 3 will Google das Google AI Ultra Abo für 280 Euro im Monat verkaufen. Über die API geht es als Pay-per-Use. Max. 8 Sekunden pro Take. Dafür ist Audio-Generierung mit dabei. Auflösungen: 720p, 1080p und 4K. Ein 8-Sekunden-Take in 720p kostet gemittelt etwa 2 Euro. Achtung: Als „Anfänger“ mit der Google AI API bist du im „Tier 1“, solange dir weniger als 250 Dollar abgebucht wurden. In Tier 1 ist das Rate Limit bei Veo 3 bei 10 Takes am Tag! Trick: Veo „normal“ und Veo „fast“ sind zwei verschiedene Modelle, also kannst du 20 Takes am Tag generieren. Der Look wird sich dann allerdings unterscheiden.

Tipp: Google Veo 3 ist auch bei Adobe Firefly Video integriert – für Abokunden.

Wenn du Google Gemini Veo 3 allgemein für weniger Geld ausprobieren willst, gibt es „Flow“ bei den Google Labs. Flow wird / kann irgendwann eine KI-Kinofilmgenerator werden. Dort darfst du mit Veo 3 Fast und Veo 3 Quality arbeiten – und du bekommst 1080p als Auflösung, leider nur per Upscaling.

100 Credits im Monat sind gratis, damit kannst du fünf 8-Sekunden-Videos mit Veo 3 Fast generieren – zu sehen im zweiten Videobeispiel (mit Gewitter).

Preis für mehr: Ab 21,99 Euro im Monat für Google AI Pro, dann sind 1.000 Credits inklusive. 10 HQ-Videos oder 50 „Fast“-Videos à 8 Sekunden kannst du dir damit im Monat „rauslassen“. Kostenmäßig ist das attraktiv – aber die Output-Limitierung macht den Einsatz schwierig.

Allerdings, und das ist cool bei Google Flow: Es gibt einen Scenebuilder. Beispiel: Eines der letzten Frames des obigen Videos wird zum Startframe für die nächste Szene. Damit lassen sich dann richtige kleine „Filme“ erstellen, im 8-Sekunden-Takt. Diese Funktion geht nur mit Veo 3 Quality, erfordert also ein Abo (oder die API).

Auch Veo 3.1 „Nicht-Fast“ (also HQ) ist nicht perfekt.

In diesen Take hat sich ein Bug eingeschlichen. Das „Someone is hoisted up on shoulders in the mid-ground, arms spread wide.“ wurde sehr ernst genommen. Schau mal rein.

Was aber echt gut ist, ist die Kamerafahrt. Die Musik hat Veo 3.1 auch drunter gelegt (die ich in diesem Fall gar nicht brauche).

Prompt:

Vertical 9:16 portrait format. Ultra-wide establishing shot of the entire beach party at the blue-hour transition between sunset and nightfall — the sky is a vertical gradient from deep burnt orange at the ocean horizon through electric purple to dark blue at the top of the frame. Dozens of young people are scattered across the glowing sand, jumping, dancing, and spinning wildly. Tiki torches and string lights create warm golden pools of light stretching along the beach in a line. Waves crash on the shore and reflect the purple-orange sky colors. The DJ booth is a rectangle of pulsing LED light — magenta, teal, white. Someone is hoisted up on shoulders in the mid-ground, arms spread wide. The young woman with curly brown hair is visible center-frame in the shallow surf, mid-spin, sarong flying. The energy is euphoric and unstoppable — this night will never end. Saturated color grading: warm amber foreground from torches, purple-teal sky, magenta LED accents. Music video aesthetic — maximum party scale, the whole beach united. Lighting: ambient blue-hour sky light from above, warm practical lights from torches and strings. Drone camera starts within the crowd at head height, then rises smoothly and steadily upward over 8 seconds, gradually revealing the full scope of the party stretching along the coastline until the entire beach fills the vertical frame.Und so sieht es mit Google Veo 3.1 (1080p) und JSON-Prompt aus:

Die Idee: Eine Tanztheater-Choreographie eine Labyrinths mit einem Roten Faden. Also: Ariadnefaden, Theseus, Kreta, usw. Das Ergebnis ist als „Moodfilm“ OK, aber strenggenommen „zerfasern“ „Darsteller“ in jedem Frame. Drücke einfach an einer beliebigen Stelle auf Pause, das ist alles nicht crisp!

Grund: Bei sehr wuseligen Szenen, hier sind locker 50+ Leute „on Stage“, kommen Diffusion-Modelle an die Grenzen (prinzipiell „meißelt“ die KI das Video aus Rauschen heraus, und wenn zuviel Bewegung im Video drin ist, bleibt zu viel unkorrigiertes Rauschen übrig). Aber auf den ersten Blick ist das kaum als KI-Video erkennbar. „Production ready“ ist es in Summe nicht.

Der JSON-Prompt dazu (den hat mir Claude Opus 4.6 erstellt, die Tipparbeit wäre monströs).

Was ist drin?

- Technical specifications (bspw. welche Art von Linse)

- Artistic direction:

- Stil: Die Beschreibung der gesamten Szenerie

- Lighting: Die Lichtsetzung, wichtig für die Konsistenz innerhalb eines größeren Projekts. Dazu geört auch der rote Licht-Spot, der die Protagonistin am Anfang erhellt (solange, bis sie aus dem Spot rausrennt).

- Mood: Stimmungsbeschreibung

- Camera Control:

- Die Kamerabewegung, also hier Steadycam und später Kran ab Sekunde 6

- Focus, also Tiefenschärfe o.ä.

- Main Text Prompt: Die Beschreibung der Szene im Detail

- Timeline Breakdown: Superinteressant. Hier kannst du reinschreiben, was bspw. in Sekunde 0-2, 2-5, 5-8 o.ä. passiert. Damit lässt sich steuern, was wann passiert.

{

"video_generation_prompt": {

"title": "The Living Labyrinth",

"technical_specifications": {

"frame_rate": "24fps",

"lens_type": "28mm anamorphic wide",

"resolution": "High-fidelity/Photorealistic",

"aspect_ratio": "16:9"

},

"artistic_direction": {

"style": "Large-ensemble Tanztheater staged inside a labyrinth that is itself alive and performed by dancers. The maze walls are tall cream-and-gold fabric panels on rolling frames, pushed and repositioned by one group of dancers while another group runs, searches, and dances through the constantly shifting corridors. The labyrinth is never the same twice — it breathes, rearranges, conspires. Symmetry flickers in and out: a corridor aligns perfectly for one beat, then a panel swings and the geometry shatters.",

"lighting": "Warm amber overhead wash across the full stage with stronger side light from frame-left raking across the fabric panels, making them glow translucent gold when backlit and casting long moving shadows as panels rotate. A single red-gelled follow spot tracks the searching figure in white, giving her a faint rose aura wherever she runs.",

"mood": "Urgent, disorienting, exhilarating — the thrill and panic of searching inside a system that keeps rewriting itself. A myth in motion. The maze is not a setting, it is an antagonist made of human effort."

},

"camera_control": {

"movement": "Dynamic Steadicam tracking shot at dancer eye-level, rushing through the corridors alongside the searching figure — the camera is inside the labyrinth, not above it. Panels sweep past on both sides. Occasional near-collisions with moving walls create visceral urgency. At the 6-second mark, the camera lifts rapidly on a crane to a high angle, revealing the full maze pattern and all thirty dancers for the final two seconds.",

"focus": "Shallow depth of field during the ground-level tracking — the searching figure sharp, panels and corridor dancers streaking into warm bokeh. Shifts to deep focus as the crane rises for the overhead reveal."

},

"main_text_prompt": "Dynamic Steadicam shot rushing through a theatrical labyrinth on a wide dark stage. The maze walls are tall cream-and-gold fabric panels — each roughly three meters high — mounted on rolling frames. Thirty dancers populate the labyrinth in two roles: fourteen panel-movers dressed in gold push, swing, and reposition the fabric walls in choreographed patterns, constantly reconfiguring the corridors in real time — a passage that existed two seconds ago closes, a new one opens to the left. Sixteen runners dressed in cream sprint, search, and perform high-energy choreography through the shifting corridors — leaping over low panels, spinning through gaps that are closing, reaching arms down corridors that dead-end as they watch. One figure in white leads — the camera follows her at eye level through the labyrinth as panels sweep past on both sides, sometimes missing her by inches. The panel-movers work in synchronized teams, swinging walls open and shut like enormous doors, creating momentary symmetrical vistas down long corridors that collapse a beat later as panels rotate. A thin crimson ribbon trails from the wrist of the figure in white, unspooling behind her through the corridors — Ariadne's thread — catching on panel edges, stretching taut around corners. The amber side light makes the fabric panels glow translucent gold when backlit, casting long sweeping shadows across the floor as they pivot. At the 6-second mark, the camera lifts rapidly on a crane straight upward, pulling out of the labyrinth and rising to a high overhead angle that reveals the full maze — thirty bodies in motion, panels still rotating, the crimson thread tracing a visible path through the corridors below, the figure in white now a small bright point in a vast shifting geometric machine. Cinematic 35mm anamorphic film grain, warm amber-and-gold palette with cream fabric panels and crimson thread accent, theatrical stage lighting with strong side raking light, dynamic Steadicam to crane transition. 16:9 widescreen.",

"timeline_breakdown": [

{

"time_range": "0–2s",

"action": "Eye-level Steadicam rushes into the labyrinth behind the figure in white. Tall gold fabric panels loom on both sides. A panel swings shut directly ahead — she pivots left through a gap. The crimson ribbon trails from her wrist. Panel-movers in gold push walls into new positions around her."

},

{

"time_range": "2–4s",

"action": "The camera follows her down a long corridor. For one beat, a perfect Wes Anderson symmetrical vista opens — a straight line of panels receding to a vanishing point. Then two panels swing inward simultaneously, erasing it. Other runners cross the corridor in both directions, leaping and spinning. The maze is alive."

},

{

"time_range": "4–6s",

"action": "Climax of ground-level chaos: panels rotate, shadows sweep, runners weave. The figure in white reaches toward another figure visible through a translucent backlit panel — a silhouette just one wall away — but a panel-mover pushes the wall between them and the silhouette vanishes. The crimson thread stretches taut around a corner behind her."

},

{

"time_range": "6–8s",

"action": "THE CRANE LIFT: the camera rises rapidly straight up, pulling out of the labyrinth. The ground drops away. The overhead view reveals the full maze — thirty dancers, panels still rotating, the crimson thread tracing a visible winding path through the corridors. The figure in white is a small bright point in a vast, beautiful, shifting geometric machine."

}

]

}

}

3. Adobe Firefly

Adobe Firefly ist die KI-Mediengenerierungs-„Suite“ von Adobe. Angenehm, wenn auch komplex, ist es, dass dir Adobe die Wahl zwischen verschiedenen KI-Anbietern lässt. Die Besonderheit dabei: Die Modelle von Adobe sind „commercially safe“, also lizenzrechtlich sauber. Ich finde das super. Die Modell von Drittanbietern sind in der Regel nicht sauber. Um sich für interne Zwecke Moods anzulegen geht das.

Bei Adobe Firefly kannst du als KI-Video-Generator zuerst mal „Firefly Video“ ausprobieren.

Es gibt viele Einstellmöglichkeiten:

- Auflösung (max. 1080p – für TV, Web und Mobile reicht’s, aber nicht für große Produktionen)

- Seitenverhältnis (16:9, 9:16, 1:1)

- Komposition: Das ist cool, denn hier kommen Regieanweisungen rein, wie ein „Vorbild“ bzw. Vorbild-Video („Referenz“), „Zoomfaktor“ (Close-up, Totale etc.), Kameraperspektive, Stil (Anime, Kino…), Seed (kennen wir ja von Bildgeneratoren – damit kann man sich den Stil „merken“)

Prompt:

Eine Gartenparty: Menschen feiern und stoßen mit Gin Tonics an.Ergebnis, „cinematic“:

Das Ergebnis mit Firefly Video ist in Summe unbenutzbar schlecht, vor allem die Zähne sind schlimm- Stichwort „Uncanny Valley“. Ganz verkehrt ist es natürlich nicht: Die Szene ist gut, die Bewegungen sind gut. Als Mock-up bzw. Alternative zu Moodboard oder Stealomatic im Kreativprozess ist das natürlich toll. Um für bspw. einen Werbespot für YouTube nutzbare Ergebnisse zu bekommen, muss man ein wenig rumexperimentieren und ggf. einfach tricksen – also üble Stellen rausschneiden oder einen fetten Super / Overlay / Störer drüberlegen, oder mit Split Screen arbeiten o.ä.

Was deutlich besser funktioniert ist die Einstellung „Vektorkunst“ (Vector Art). Hier ist das alles verfremdet, man hat also kein Uncanny-Valley-Störgefühl. Solche Vector-Art-Videos kann ich mir gut für Websites, Powerpoints, Erklärvideos etc. vorstellen.

Schauen wir uns das optionale Ray3 von Luma an, das in Adobe Firefly verfügbar ist:

- Auflösung geht bis 1080p – viel besser als Veo

- Beim Seitenverhältnis geht auch 3:4 oder 21:9 – das ist echt super. Ich brauche ab und an Content in 21:9 (v.a. Fotos) u.a. für Websites, da das Design bzw. CMS mit 16:9 schlecht klarkommt

- Weitere „Prompt Template“ Einstellungen wie bei Firefly Video gibt es nicht

Kurzum: Liebe Leute, das ist fast „production ready“. Auf den ersten Blick sehe ich keine groben Fehler. Auf den zweiten Blick sieht man allerdings, dass der Typ rechts mit dem Hut kein Glas in der Hand hat. Nach 5x mal Ansehen wirkt das extrem befremdlich. Solche Kleinigkeiten würde man aber durch nachprompten in den Griff bekommen. Die Basis stimmt!

Auch nett: Da wir in der Adobe-Welt sind, sind im Video „Content Credentials“ integriert. Das bedeutet, dass für User rückverfolgbar ist, dass das Video KI-generiert ist (außer man rendert das Video um, dann gehen die Content Credentials verloren).

Luma Dreammachine Ray3 Tipps und Preise

Das KI-Videogenerierungs-Tool Ray3 von Luma gibt es natürlich auch bei Lumalabs direkt. Ein paar Dinge musst du beachten:

- 4k-Output ist möglich, aber das ist nur hochskaliert von 1080p.

- Mit Ray3 sind bis zu 20 Sekunden möglich.

- Ray3 kann (noch) kein Audio.

- Ray3 HDR kann nur 720p – das ist Mist.

- Wenn du die Ergebnisse kommerziell nutzen willst, brauchst du ein Abo, und zwar mindestens den Web Plus Plan für $29,99 im Monat. 10.000 Credits im Monat sind inclusive.

- Empfehlenswerter, gerade für den Anfang, ist der Web Unlimited Plan für $94,99 im Monat, denn da gibt es nicht nur die 10.000 „guten“ Credits, sondern auch eine Flatrate für den „Relaxed Mode“. Wenn deine „guten“ Credits aufgebraucht sind, kannst du immer noch im Flatrate-Bereich arbeiten. Bis die Ergebnisse da sind dauert es dann länger. Der „Break Even“: Ab 30.000 verbrauchten Credits im Monat lohnt sich das.

- Ein 10-Sekunden-Video mit Ray3 in 1080p kostet in etwa 660 Credits – für die 30 Dollar bekommst du also 15 Zehnsekünder im Monat. Rechne davon noch die Fehlversuche runter, und dann bleibt wenig übrig. Für erste Tests sollte man deshalb bspw. Ray3 Draft als Fünfsekünder zu 60 Credits nehmen, dann reichen die 10.000 Credits für 166 Videos, also 13 Minuten.

Mit Web Unlimited bist du nicht limitiert. - Es geht aber auch teurer: Ray3, 720p, Ausgabe in HDR plus EXR: 10 Sekunden für 4480 Credits. Da kosten dich 10 Sekunden dann 15 Dollar. Ups.

- Wenn die Credits weg sind, kannst du welche nachkaufen: 1.200 Credits kosten ab 4 Dollar. Credits kaufen geht nur, wenn man ein Abo hat.

- Der Preis für die vergleichbare iOS-Apps ist mit $37,99 deutlich höher (iOS Plus Plan) – denn Apple will ja Provision.

- Alternative: die API (die auch Adobe nutzt): Der Preis liegt bei $0,0032 pro Megapixel pro Frame. 5 Sekunden 720p liegen wohl bei $0,40. API-Credits und Abo-Credits werden separat verbucht und sind nicht mischbar.

4. Oxolo: die KI-Avatare sind gut

Oxolo bietet an, dass du einfach eine URL einer Website oder einer Landingpage eingibst und daraus dann ein Video erstellt wird – mit KI-Avatar und Sprecher.

Der KI-Avater ist ganz OK, die deutschen Stimmen sind auch in Ordnung.

Das Tool selbst ist allerdings lachhaft: Ich hab’s getestet, und im Video wird das Cookie-Banner der Landingpage vorgelesen. Ay Caramba. Die Texteinblendungen sind grauenhaft. Und der gesamte Inhalt des Videos ist unbenutzbar. Wo soll man da anfangen? Das ist für die Tonne.

Fairerweise muss man sagen: Die Funktion ist einfach nicht ausgereift und mit manueller Nacharbeit bekommt man die Probleme in den Griff.

Die Avatare selbst sind brauchbar, wenn man die rangezoomte Version nimmt. Es gibt auch Avatar-Versionen, bei denen man die Hände sieht, und die bewegen sich erratisch roboterhaft.

Script und Hintergrund sollte man in jedem Fall selbst erstellen bzw. aus Stock-Videos zusammenzuschen. Noch besser ist es vielleicht, den KI-Avatar einfach wegzulassen.

5. HeyGen: Gute Video-Avatare und Integration in Adobe Express

HeyGen ist ganz gut, um KI-Video-Avatar-Videos zu generieren. Es gibt viele Templates fürs Video-Design, die „Figuren“ sind gut und die Stimmen sind sogar Dialekttauglich. Im Test-Video habe ich Schweizerdeutsch verwendet, das funktioniert gut! Dialekte sind schwierig, da die Aussprache stark von der Schriftsprache abweicht.

Der erste Teil des Videos ist ein von mir KI-generiertes Foto eines Bärtigen, das durch HeyGen animiert wurde. Das Ergebnis finde ich beachtlich – immerhin ist das die Schmalspur-Free-Version. Mit einem „Studio Avatar“ wird die Sache dann ziemlich gut: Nehme ein Green-Screen-Video von deinem Protagonisten auf und lasse daraus einen KI-Avatar rendern. Da bekommste dann deine eigene Urlaubsvertretung… wenn du dann noch ein Conversational Voice AI wie Retell AI dazwischenschiebst und du eine Anbindung an Live-Video hinbekommst, könntest du Video-Meetings von der KI machen lassen während du im Garten in der Sonne liegst…

Tipp: Freigestellte „Menschen“ sind als Avatare besser, da man dann den Hintergrund für Videos, Slides, Charts und Super verwenden kann.

HeyGen hat natürlich auch einen GPT Script Writer eingebaut, der das Script schreibt. Wie gut so ein Script für einen geeignet ist, muss man für sich selbst entscheiden. Die Super und den restlichen Kram musst du immer noch selbst machen.

6.1 Invideo AI: KI-Stock-Video-Zusammennagler

Invideo AI solltest du im Auge behalten, aber richtig gut es noch nicht. Es ist das Text-to-Video-KI-Videogenerierungstool von invideo.io: Du gibst ein kurzes Briefing ein, und InVideo erstellt daraus ein Video aus Stockmaterial. Die (Video-)Quellen sind unter anderem Storyblocks, Shutterstock und iStock. Diese Videos sind als Prototyp / Animatic / Stealomatic geeignet. Um daraus ein voll nutzbares Video zu machen, musst du a) Zeit investieren, b) an die Post Production denken.

Im ersten Schritt gibst du einen Prompt ein, mit dem das Script generiert wird (geht derzeit nicht auf Deutsch). Danach wählst du Zielgruppe (z.B. Führungskräfte), Look & Feel (z.B. Inspiring) und Zielplattform aus (z.B. LinkedIn, YouTube).

Jetzt wird auch schon das Video generiert, mit Bild, Voice Over, Supers und Musik. Bild und Text passen oft zusammen, aber nicht immer.

InVideo Studio hingegen kann Deutsch! Also zumindest kannst du deutsche Voice Over generieren lassen.

Der kleine Button „Edit“ ist also extrem wichtig: Dort schraubst du am Script und an den Assets. Videoschnipsel austauschen ist ganz einfach. Das musst du auch, denn InVideo baut gern Stills ein (also Fotos) und nicht ganz passendes Footage.

Eigene Assets, wie Logos, Charts/Stills oder Videosequenzen, baust du in diesem Schritt auch ein.

Das Beispielvideo kannst du dir hier ansehen: https://ai.invideo.io/watch/5m4I8n2GWDG

6.2 InVideo Studio

Mit InVideo* Studio sieht der Workflow anders aus, und man bekommt tatsächlich verwendbare Ergebnisse. Der Trick: Es steckt wenig KI drin – es ist mehr ein Video-Schnittprogramm mit Templates (vgl. Canva).

Erst macht man das Script (auch mit KI-Support) und legt ein Template fest, dann sucht das System zum Text und zum Template passend Videos zusammen. Nicht schlecht! Oft sind die rausgesuchten Szenen allerdings lachhaft schlecht.

Die einzelnen Szenen kannst du bearbeiten (Logo einfügen, Super ändern, Grading-Vorlage drüberlegen, Video tauschen), dann fügst du ein Voice Over dazu (KI-generiert oder eine Datei von deinem Rechner), und Musik kommt auch drunter. Das Video exportierst du dann, als Download, oder auch als Direkt-Upload bei YouTube (das ist nicht nur wegen möglicher Musik-Rechte ganz praktisch).

Das Beispielvideo auf Englisch zeigt, was auf die Schnelle möglich ist. Die KI-Stimme ist nicht auf Weltklasse-Niveau. Die Stock Videos sind gut, obwohl ich absichtlich auf „Premium“ Stock (iStock) verzichtet habe. Ich habe ein paar Fotos dringelassen, um die Foto-Animations-Qualität bewerten zu können. Ist ganz OK! Durch die Grading-Vorlage wird der Look ein bisschen „filmischer“.

Da das Video nur eine Demo ist, habe ich mir Intro, Outro und Feinschliff aller Art gespart.

Ein paar Funktionen vermisse ich, beispielsweise eine halbautomatische „Ich brauche das Video in einer anderen Sprachversion“ Funktion.

InVideo hat auch Nachteile: Es ist, je nach Rechner, grottenlangsam – und die Bild-/Video-Asset-Vorschläge out of the Box sind teils ärgerlich schlecht. Aber netto gesehen ist man in der Regel schneller als mit Handarbeit (Videos suchen, schneiden, Super / Bauchbinden bauen). Ein professioneller Editor liefert außerdem deutlich bessere Ergebnisse ab, ich kann da gern Leute empfehlen.

Ist InVideo kostenlos?

Es gibt quasi zwei „InVideos“: „AI“ und „Studio“. InVideo AI ist zum Rumspielen kostenlos, um Testvideos zu erstellen. Die Videos lassen sich sogar exportieren oder per Link teilen. Diese Videos sind allerdings nicht nutzbar, da sie verschiedene Wasserzeichen haben. Die Lizenzbedingungen lassen damit einen realen Einsatz nicht zu, und abgesehen davon sind Videos mit Wasserzeichen superpeinlich. Für InVideo Studio brauchst du für den Export ein Upgrade, du musst also zahlen.

Und wie es sich für strubbelige Cloud-Tools so gehört, fühlen sich „AI“ und „Studio“ wie getrennte Produkte an – was sie auch sind.

Wie viel kostet InVideo?

Ab 25 Dollar im Monat geht’s für InVideo AI los, InVideo Studio ab 30 Dollar. Der Preis ist ein echter Schnapper, da du für die Videos iStock Footage verwenden kannst. Das ist sonst richtig teuer.

Blöd: Das Abo für Studio gilt nicht für AI und umgekehrt. Du brauchst also zwei Abos. Das kann man sich sparen. Mit Studio fährst du viel besser, da es mehr Kontrolle übers Ergebnis bietet und es vor allem mehrere Sprachen kann.

Ausnahme: Du willst auf die Schnelle Protoypen für Videos auf Englisch machen, dann ist AI besser.

Warum wird Invideo.ai online so gefeiert?

Invideo.ai bietet „Influencern“, Content Creators und Glücksrittern Verkaufsprovisionen. Einige der Jubel-Arien dürften also knallharte Schleichwerbung sein.

Und was ist mit Sora?

Sora ist die (kommende) KI-Video-Generierungs-Schwester von Chat GPT und Dall-E, gehört also zur Open-AI-Familie. Durch die Eingabe eines Briefings in natürlicher Sprache wird ein Video-Generierungsprozess gestartet.

Sora von Open AI funktioniert nach dem „Diffusion“-Prinzip: Es wird, ähnlich zur Bildhauerei, ein Steinklotz genommen (= Rauschen) und nach und nach alles weggekloppt, was nicht nach einer Michelangelo-Statue aussieht. Die Ergebnisse sind dann teilweise funky.

Von Stability AI gibt’s was Vergleichbares, nämlich Stable Video Diffusion (Image-to-Video-Generierung) und Stable Video 3D. „Production quality“ hat das alles nicht.

Mehr Magie: Profis ranlassen

Die Online-Schnittprogramme sind der Bedienung ein bisschen nervtötend, weswegen meine Empfehlung gilt:

Buche Profis für deinen Film, die mit Blackmagic Resolve / After Effects oder was auch immer umgehen können. Sonst sieht dein Video nämlich aus wie billig zusammengestückelt.

Und investiere in ein gutes Script. Das kostet nicht viel und ist didaktisch überzeugend.

Die Zukunft von Video in einer Welt mit KI

- Szenario 1: Die für jedermann einfache Möglichkeit zur Erzeugung von Videos wird dafür sorgen, dass das Internet mit Videos überschwemmt werden wird.

- Folge: Es wird immer schwerer, sich mit seinen Videos durchzusetzen.

- Lösung: Du brauchst a) kreativere Video-Ideen (= Storytelling) und b) wird man mehr selbst filmen lassen müssen, um einzigartig zu sein.

- Szenario 2: Die Post Production wird massiv vereinfacht. Stockvideos und eigene Videos lassen sich künftig einfach manipulieren. Im Hintergrund stört ein Karton? Ein Passant läuft durchs Bild? Das eigene Produkt soll eingebaut werden? Diese Tasks wird KI lösen, mit „generative fill“, Inpainting, Outpainting und anderen Techniken.

- Folge: Videos werden durch die Bank professioneller aussehen, und man muss beim Dreh weniger auf Kleinigkeiten achten. Kamera-interne KI-Funktionen werden hinuzukommen und bei der Bildgestaltung helfen. Die aktuellen Android- und iOS-Smartphones gehen ja schon in die Richtung.

- Lösung: Du brauchst kreativere Videos, denn perfekte Videos sind dann keine Kunst mehr. Es wird also eine Raw-/Handmade-/LowFi-Gegenbewegung geben. Ich würde auf ein 8mm-Film-Revival wetten.

Fazit

Mit den KI-Video-Generierungs-Tools Invideo AI und HeyGen ist es möglich, Bewegtbild-Content bzw. KI-Avatare zusammenzuzimmern. Ganz ausgereift ist das alles nicht, aber in jedem Fall kannst du das Bewegtbild-Storyboarding bzw. -Prototyping beschleunigen.

Stelle dir jedoch die Frage, ob deine Marke durch künstliche Menschen und Videos aus der Stock-Kiste hochwertiger als bisher erscheint, oder ob das für die Marke riskant ist. Es kommt einfach auf den Einsatzzweck an: Ein zusätzliches Tutorial-Video mit KI-Avatar ist vielleicht nutzerfreundlicher als eine 100-seitige Anleitung als PDF.

Über den Autor

Stefan Golling, Köln. Seit 2011 unterstütze ich freiberuflich Unternehmen bzw. Agenturen mit kreativen Ideen, Konzepten und (textlichen) Umsetzungen rund ums (Online-)Marketing. Vorher: 1998 mit Radiowerbung in Stuttgart gestartet, 2000 als Junior-Werbetexter zu Publicis München, 2001 Counterpart Köln, 2002 als Copywriter zu Red Cell Düsseldorf (heißt heute Scholz & Friends), dort ab 2007 Creative Director.

Kontakt aufnehmen

Artikel zu ähnlichen Themen

- Instagram: Bilder, Videos, Formate für Frustrierte

- Vibe Coding mit dem Google AI Studio: In diese Fallen kann man tappen

- Abo statt Frust: Honorarvereinbarungen (Retainer)

- KI-Bilder erkennen: Kennzeichnung via „Content Credentials“

- Die beste KI

- Markenidentität trotz KI-Nutzung konsistent halten: Tipps, Anregungen & Finetuning

- LLM-as-a-Judge: KI-Modelle als Bewertungsinstanz

- MCP: Die Universal-API der KI-Welt

- Human in the Loop: So schlägt die KI das „gefürchtete“ Atari-Schach

- Longevity Marketing: So finden Kunden und Marken zusammen

- Projektmanagement im Marketing: PRINCE2 oder V-Modell® XT?

- Marketing-Digitalisierung: Mehr als nur Software und Automatisierung

- Öffentlichkeitsarbeit: Instrumente, die auch Digital und Social funktionieren

- Employer Branding Kampagnen: Darum solltest du viel mehr KPIs messen

- Recruiting: Vom Employer Branding zum Job Content Branding

- Dynamic Pricing, mal echt anschaulich

- Marketing Automation: 3fach gedacht, plus Customer Experience

- UX-Writing Crashkurs: Do’s und To do’s

- Social-Media-Management-Workflow? Mehrsprachig!

- Website-Audit-Planungshilfe

- KI-Agenten: talentierte Helferlein

- Prompting aufgeschlüsselt: Vieles ist unsichtbar

- KI-Bildgenerierung: SVG, Diffusion oder GAN?

- LLMs verstehen: Token und Vektoren als Dashboard

- Claude: Was kann die KI von Anthropic?

- Performance Marketing: Leistung braucht Kreativität

- Marketingberatung: Erst das Rezept, dann ans Werk

- Social Selling: Hallo wer? Oder Ja gern?

- KI-Ethik und EU AI Act: Mitdenken ist Pflicht

- Customer Journey: Das Ziel ist das Ziel

FAQ

Was ist ein Animatic?

Ein Animatic ist ein Video, das aus Scribbles und Illustrationen erstellt wird. Es ist damit eine Art animierter Zeichentrickfilm. Entweder werden nur die Illus des Storyboards hintereinandergeschnitten oder manchmal werden auch komplexe Szenen grob animiert. Sinnvoll ist ein Animatic, um das Timing einer Filmsequenz zu testen. Vor allem aber werden Szenenaufbau, Setdesign und Kameraeinstellungen sichtbar. Sinnvoll ist es, ins Animatic Voice Over, Dialoge und Musik einzubauen.

Ein Animatic wird von Profis für Profis erstellt. Filmlaien, sagen wir mal „Leute in Marketingabteilungen mit wenig Filmerfahrung“, kommen mit Animatics nicht gut klar. Das liegt daran, dass man viel Vorstellungskraft braucht: Die Scribbles sind schon mal sehr rough.

Wenn man ein Animatic eines TV-Spots braucht, das im Rahmen von Marktforschung „echten“ Endkonsumenten mit minimalem Filmverständnis gezeigt wird, wird der Aufwand erhöht: Die Illus sind dann richtig gut, vielleicht sogar photorealistisch. Als Sprecher nimmt man einen Profi.

Was ist ein Stillomatic?

Ein Stillomatic ist ein Video, das aus Einzelbildern – englisch „Stills“ erstellt wird. Wenn man unternehmenseigene Fotos oder Stockbilder benutzt, kann man daraus nicht nur Test-Videos machen, sondern auch „fertige“ Videos bauen. Den Diashow-Effekt (kennt noch jemand Dias?) muss man dann als Stilmittel einsetzen.

Ein Stillomatic hat gegenüber dem Animatic den Vorteil, dass die Betrachter nur wenig Abstraktionsvermögen brauchen. Der Nachteil ist, dass man sich auf Fotos beschränken muss – man kann also der Fantasie nicht freien Lauf lassen. Ausnahme: Du nimmt ein Tool zur AI-Bildgenerierung. Etwas tricky wird es dabei, einen einheitlichen Look hinzubekommen. Allein über das Grading, also die Farbkorrektur, klappt das nicht immer. Du musst also Bilder aussuchen, die visuell zusammenpassen. Das schränkt die Auswahl ein.

Was ist ein Stealomatic?

Ein Stealomatic ist ein Video das mit zusammengeklauten – ja, das „steal“ steht genau dafür – Videosschnipseln geschnitten wird. Solche Videos kann man nur für interne Zwecke verwenden, sagen wir mal eine kleine Vertriebstagung ohne externe Zeugen oder zur Visualisierung von Storyboards. Manchmal kann man das Videomaterial lizenzieren, dann ist ein legaler Einsatz möglich.

Was ist Stock Footage?

Stock Footage ist Videomaterial, das von professionellen Videografen gedreht wurde. Das Wort Footage kommt aus der englischen Filmsprache: der verfilmte Film wird in der Längenheinheit Fuß gemessen. Dieses Videomaterial findest auf Online-Plattformen: Entweder sind die Videos a) lizenzpflichtig, dann musst sie für einen gewissen Zeitraum lizensieren, b) lizenzfrei, dann kann du die Lizenz einfach so kaufen oder c) kostenfrei, dann musst du weder zahlen noch (je nach Plattform) die Urheber angeben.

Neben „commercial“ Stock Footage, das man für Werbung verwenden kann, gibt es noch „editorial only“ Footage, das nur für den redaktionellen Einsatz nutzbar ist. Für den Einsatz in Spielfilmen ist (historisches) Editorial Footage meist lizenzierbar.

* Affiliate-Link