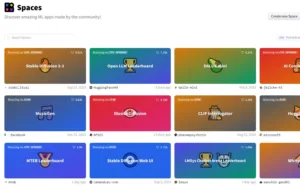

Hugging Face Spaces sind eine Art “KI-Store” mit KI-Apps auf der KI-Plattform Hugging Face, die vor allem für die Chat-GPT-Alternative Hugging Chat bekannt ist (und bei Profis für Transformers). Dort kann man live zusehen, wie sich die KI-Forschung täglich weiterentwickelt. Hier sind 6 Beispiele für Apps.

Inhalt

Was ist Hugging Face?

HuggingFace.co ist der große KI-Abenteuerspielplatz. Du kannst dort eigene KI-Produkte basteln, und zwar durch Zugriff auf große Sprachmodelle, Text-to-Speech-Bibliotheken, Bildmanipulationen oder was auch immer. Vor allem aber ist Hugging Face (HF) ein öffentliches Labor, in dem man – oft noch unperfekte – KI-Apps von Mitgliedern bzw. Teams ausprobieren darf. Da sind dann auch Branchengrößen vertreten, die dort an Innovationen basteln. Zudem ist es möglich, KI-Modelle gegeneinander zu benchmarken.

Was sind die Hugging Face Spaces?

Hugging Face Spaces ist eine Art “KI-Appstore”. Jeder “Space” ist eine “App”. Die Spaces sind ohne Login frei aus dem Internet zugänglich. Mit einem Account kannst du jederzeit eigene Spaces bauen. Man hat relativ viele Freiheiten und kann sich dank Gradio-Integration relativ schnell Apps erstellen – oder du kannst andere Spaces klonen, auf privat stellen und damit herumexperimentieren. Oft braucht man aber Programmierkenntnisse (Python), Tokens oder (kostenpflichtige) CPU-Upgrades. Mit Low-Code kommt man relativ weit, aber ist keine No-Code-Welt.

Manche der Spaces sind State-of-the-art und vielleicht erst wenige Stunden alt, andere wirken auf den ersten Blick sperrig und unverständlich. Zahlreiche Spaces schlafen oder sind kaputt. Ein Beispiel: Mit der Suchfunktion findest du viele Spaces, die “Whisper” verwenden, eine Sprach-Transkribierungs-Bibliothek. Gehe nicht davon aus, dass du auf Anhieb einen Space findest, der zuverlässig funktioniert.

Was ist Hugging Chat bzw Hugging Chat Assistants?

Hugging Chat ist ein KI-Chatbot und damit eine Alternative zu Chat GPT. Eine Besonderheit ist, dass du das Sprachmodell (LLM) dahinter wechseln kannst. Empfehlenswert ist beispielsweise mistralai/Mixtral-8x7B-Instruct-v0.1. Das ist echtes Open Source (Apache 2.0 Lizenz) und kann sehr gutes Deutsch und Französisch. Du kannst dort auch Llama von Meta oder Google Gemma 7B ausprobieren (veröffentlicht am 21.02.24). Gemma kann allerdings nur Englisch.

Mit Hugging Chat kann man Hugging Chat Assistants bauen. Diese sind so ähnlich wie die Custom GPTs bei Chat GPT, also ein Tool, mit dem man in 5 Minuten seinen eigenen Chat Bot zusammenstellt. Man wählt das Sprachmodell aus (z.B. openchat), “brieft” den Bot (You act as…) und kann dort das Thema vorgeben. Zugleich hast du Zugriff auf Hunderte Chatbots, die von Usern angelegt wurden. Manche davon sind Wow, manche sind alberner Spielkram.

Einen Beispiel-Bot findest auf der Seite Marketingmaßnahmen. Dieser Bot hat ein Spezialgebiet und einen deutlichen (gewünschten) Bias…

Ist Hugging Face bzw. Hugging Chat kostenlos?

Ja, Hugging Face ist für den Einstieg kostenlos. Aber natürlich will die Firma Geld verdienen: Man kann kostenpflichtig Rechnerzeit dazukaufen und/oder sich die Hugging Face Pro-Mitgliedschaft für ca. 9 USD im Monat dazubuchen.

Ich habe 5 Beispiele für Hugging Face Spaces rausgesucht, die ein bisschen zeigen, wo die KI-Reise so hingehen kann.

6 Beispiele für KI-Apps bei Hugging Face

1. Image to Music V2 auf Hugging Face

- Die Hugging Face-App Image to Music V2 erschafft zu Bildern einen Soundtrack.

- Das passiert:

- Erst das Bild hochladen

- Dann liest ein Image-to-Text-Modul (Kosmos2) den Inhalt des Bildes aus.

- Dann schreibt das große Sprachmodell daraus einen inspirierenden Musik-Prompt – also das Briefing an den „KI-Komponisten.“

- Für dieses Bild wurde dieser Prompt automatisch generiert: “A minimalist electronic beat with glitchy textures and pulsating arpeggios, accompanied by a haunting synth melody, evokes a futuristic and technological atmosphere as if the scene is set in a sci-fi laboratory.”

- Je nach Musiksynthese-Modell kommen katastrophale oder sehr gute Ergebnisse raus.

Und so hört sich das Ergebnis an:

In anderen Spaces gibt es Tools, um Soundeffekte (SFX) unter Fotos zu legen.

Künftiger Einsatzzweck: Die automatische Vertonung von Videos, also Musik und SFX.

2. Screenshot to HTML auf Hugging Face

Die App Screenshot to HTML macht aus Fotos von Websites den passenden HTML-Code. Das klappt nicht hundertprozentig, aber fast.

Künftiger Einsatzzweck: Male eine Website auf einem Blatt Papier auf und lasse dir die Seite daraus bauen. Oder stelle dir eine Templating-Funktion in einem Content-Managment-System vor, bei der du dich nicht mit Elementen und Codeschnipseln herumärgern muss.

3. Photomaker auf Hugging Face

Photomaker[1] erstellt aus Geht-so-Fotos sensationelle Fotos. Das Team dahinter ist vom chinesischen Internetgiganten Tencent, dem Betreiber von QQ.

In diesem Beispiel habe ich es für die Restaurierung des Gesichts des Mannes aus meinem KI-generierten Bild genutzt. Das Gesicht ist ziemlich unkenntlich.

Der Prompt: „man img, instagram photo, portrait photo of man“.

Das Ergebnis ist ein Portraitfoto, das ich nicht auf den ersten Blick als KI-generiert erkenne.

Künftiger Einsatzzweck: Stelle dir eine Kamera-App vor, die aus Schnappschüssen automatisch super Fotos für Social Media bastelt, und zwar ohne Prompt Engineering.

Oder stelle dir eine Polizei-App vor, die selbst auf schlechten Aufnahmen von Überwachungskamera alle Gesichter restauriert und sie dann mit der großen Gesichtsdatenbank abgleicht.

4. Background Removal auf Hugging Face

Background Removal übernimmt das lästige Freistellen von Fotos. Das funktioniert ziemlich gut. In diesem Beispiel hat das Viech allerdings den Schweif eingebüßt. Und der Jockey ist jetzt einbeinig.

Adobe Firefly, Canva und viele weitere Apps können das natürlich auch bzw. besser.

Der Charme an Background Removal ist jedoch, dass es a) vollautomatisch funktioniert und b) lokal im Browser läuft; es ist also sauschnell und kostet den Anbieter keine Serverzeit.

Die Technik dahinter stammt von Bria.ai und ist Open Source. Das Release war am 6. Februar 2024.

Bria.ai ist ein KI-Fotoretusche-Werkzeug, das man legal kommerziell einsetzen kann. Die großen Werbeagenturen Publicis und McCann machen es, laut offizieller Referenzliste.

Der Grund: Die Trainingsdaten sind lizensiert, was aber nicht bedeutet, dass man die Bilder wirklich verwenden darf (es steht nicht dabei, ob die Foto-Basis Editorial-only ist…). Mit Bria kann man allerhand (sinnvollen) Schabernack anstellen, wie Gegenstände aus Bildern rausretuschieren (mit einem Klick) oder Gesichter verändern. Ein Gesicht kannst du lächelnder machen, älter, die Haarfarbe ändern, und auch teils ist auch die Ethnie anpassbar.

Künftiger Einsatzzweck: Foto-Apps oder digitale Spiegel. Stelle dir vor, du stehst in einer Umkleidekabine, es ist Januar, und probierst Sommerklamotten an – und zwar mit einem „Spiegel“, der dich in einem Video am Strand zeigt.

5. Replace Anything auf Hugging Face

Replace Anything von modelscope ist ein Werkzeug zur Bildbearbeitung. Hintergrund entfernen reicht dir nicht? Dort kannst du Elemente in Bildern per Text-Prompt durch etwas anders ersetzen. Dahinter steckt natürlich keine Hobbybude, sondern Alibaba aus China. Die Bedienung ist tricky, deswegen habe ich eine Anleitung für dich.

So geht’s:

- Klicke im Mini-Tab oben auf “Image create”

- Lade ein Bild hoch, ich nehm hier mal das Stock-Bild mit den rosa Regenschirmen.

- “Click to seg”: Hier klickst du an, was behalten oder austauschen willst. Hier gibt es 2 Modi:

- Foreground: Du klickst ein Objekt an. Das Tool wendet eine Art Zauberstab an und markiert das Objekt, hier den Regenschirm, mit einem grünen Dreieck. Diese Objekte werden bleiben, der Rest wird ersetzt.

Tipp: Nutze vor allem diese Funktion, und behalte nur ein Objekt. Das Tool schmiert sonst gern ab. - Background: Wenn du auf “Background” klickst, wählst du die Objekte aus, die ausgetauscht werden sollen. Die Markierung ist ein rotes x. Du kannst die Funktion nutzen, um Fehler des automatischen Zauberstabs zu korrigieren.

- Kombination: Du kannst “Foreground” und “Background” gleichzeitig bearbeiten.

- Foreground: Du klickst ein Objekt an. Das Tool wendet eine Art Zauberstab an und markiert das Objekt, hier den Regenschirm, mit einem grünen Dreieck. Diese Objekte werden bleiben, der Rest wird ersetzt.

- Prompt: Gebe ein, was anstelle des Hintergrunds erscheinen soll. Ich wähle “Futuristic star ship”

- More input parameters: Du kannst eigene Bilder zufüttern, oder eine Maskierung. Bei Gesichtern werden Zusatz-Prompts empfohlen

- Run: Startet den Vorgang. Manchmal erscheint einfach “Error.” Pech gehab.

- Outputs: Zeigt die Outputs. In diesem Fall ist der Regenschirm jetzt in einem Raumschiff. Kann man immer mal brauchen, zusätzlich zu einem guten Handtuch…

6. Stable Video Diffusion auf Hugging Face

Aus Bildern Videos machen wird das nächste große Ding. Stable Video Diffusion kann das in Ansätzen. In diesem Beispiel wird das „Bullriding“ erkannt und in Bewegung umgesetzt: Der Schweif wackelt, allerdings bewegt sich auch der Huf – sehr creepy. Die Hörner werden als Ohren interpretiert. Übrigens: Chat GPT 5 soll das auch bald können.

Alternative: Dynamic Crafter

Künftiger Einsatzzweck: Beispielsweise Special Effects in der Videobearbeitung.

Fazit

Hugging Face und die Hugging Face Spaces geben einen Ausblick darauf, wie es wäre, wenn sich jeder seine eigenen KI-Apps selbst zusammenbasteln könnte.

Über den Autor

Stefan Golling, Köln. Seit 2011 Freelance Creative Director, freier Texter, Creative Consultant und Online-Marketing-Berater mit Kunden von Mittelstand bis S&P 500. Erfahrung: 1998 mit Radiowerbung in Stuttgart gestartet, 2000 als Junior-Werbetexter zu Publicis München, 2001 Counterpart Köln, 2002 als Copywriter zu Red Cell Düsseldorf (heißt heute Scholz & Friends), dort ab 2007 Creative Director.

Kontakt aufnehmen? Einfach Nachricht schreiben

[1] PhotoMaker: Customizing Realistic Human Photos via Stacked ID Embedding. Li, Zhen and Cao, Mingdeng and Wang, Xintao and Qi, Zhongang and Cheng, Ming-Ming and Shan, Ying. arXiv preprint arxiv:2312.04461, 2023

Artikel zu ähnlichen Themen

- Marketing Automation: 3fach gedacht, plus Customer Experience

- Social-Media-Management-Workflow? Mehrsprachig!

- Website-Audit-Planungshilfe

- KI: Machine Learning, Generative KI & RPA als Team

- Prompting aufgeschlüsselt: Vieles ist unsichtbar

- LLMs verstehen: Token und Vektoren als Dashboard

- Claude: Was kann die KI von Anthropic?

- Performance Marketing: Leistung braucht Kreativität

- Marketingberatung: Erst das Rezept, dann ans Werk

- Social Selling: Hallo wer? Oder Ja gern?

- KI-Ethik und EU AI Act: Mitdenken ist Pflicht

- Customer Journey: Das Ziel ist das Ziel

- Chat GPT: Überblick, GPTs nutzen, Alternativen

- Google Gemini: KI mit Riesenhirn

- Statt Online Marketing Agentur: Flexibler mit Freelancern?

- TikTok für Unternehmen: 4 schnelle Tipps

- KI-Videogenerator: Meine Testergebnisse

- KI-Bild generieren: und die Lizenz? Mit Vergleichstest!

- Hugging Chat Assistants: Alternative zu Custom GPTs

- Marketingmaßnahmen als 5-Dimensionen-Modell (mit Chat Bot)

- Hugging Face Spaces: der KI-Abenteuerspielplatz

- Chat GPT: Plus? Nein. Team? Ja. 2 Gründe

- Prompt Engineering: 5 Text-to-Text-Konzepte für Nicht-Nerds & Ausblick

- KI im Marketing: Turbo-Praktikanten und die Zukunft

- KI-Marketing-Tools: 5x gratis ausprobieren